Разлика между Apache Spark и Apache Flink

Apache Spark е клъстерна изчислителна рамка с отворен код, разработена от Apache Software. Apache Spark е много бърз и може да се използва за мащабна обработка на данни. Това е алтернатива на съществуващите широкомащабни инструменти за обработка на данни в областта на големите технологии за данни. Apache Flink е рамка с отворен код за обработка на потоци от приложения за стрийминг на данни за висока наличност, висока производителност, стабилност и точност в разпределените приложения. Apache Flink осигурява ниска латентност, висока производителност в поточния двигател с толеранс при повреда в случай на повреда на двигателя с данни или машината.

Нека да проучим подробно за Apache Spark и Apache Flink подробно:

- Spark е клъстерна изчислителна рамка с отворен код, разработена от Apache Software Foundation, която първоначално е разработена от Калифорнийския университет Беркли и е дарена на фондация Apache по-късно, за да я направи с отворен код.

- Apache Flink е софтуерна рамка с отворен код, разработена от Apache Software Foundation. Основният компонент на Flink е разпределен поток и обработка на данни, който е написан на Java и Scala.

- Apache Spark е много бърз и може да се използва за мащабна обработка на данни, която се развива много в наши дни. Той се превърна в алтернатива на много съществуващи мащабни инструменти за обработка на данни в областта на големите технологии за данни.

- Apache Spark може да се използва за стартиране на програми 100 пъти по-бързо от Map Reduce работни места в среда Hadoop, което прави това по-предпочитано. Spark може да се стартира и в облака Hadoop или Amazon AWS чрез създаване на екземпляр Amazon EC2 (Elastic Cloud Compute) или самостоятелен клъстер режим и също така достъп до различни бази данни като Cassandra, Amazon Dynamo DB и т.н.,

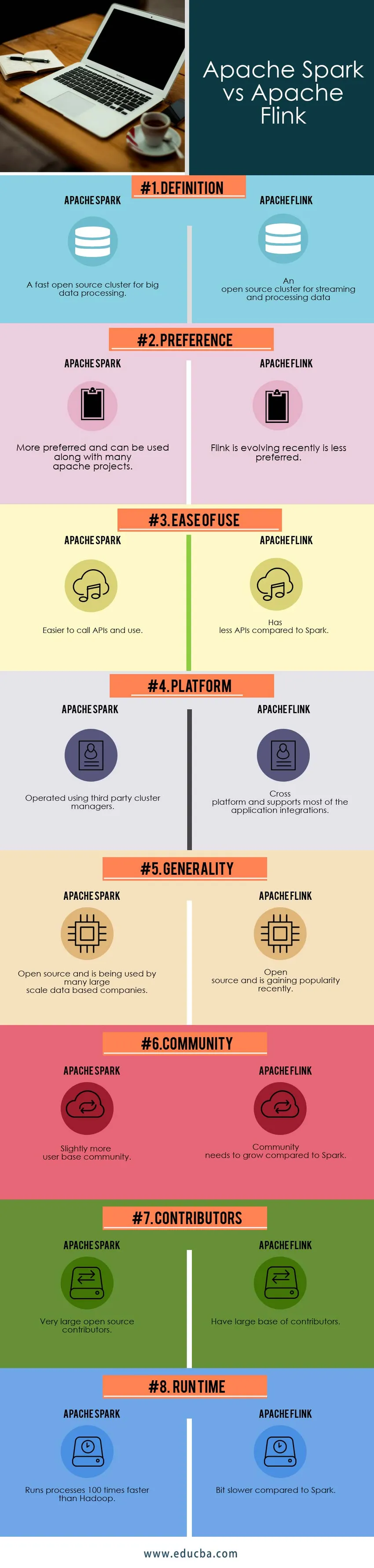

Сравнение между главата на Apache Spark срещу Apache Flink (Инфографика)

По-долу е топ 8 сравнението между Apache Spark срещу Apache Flink

Ключови разлики между Apache Spark срещу Apache Flink

- Spark е набор от интерфейси за приложно програмиране (API) от всички съществуващи проекти, свързани с Hadoop, повече от 30. Apache Flink по-рано беше изследователски проект, наречен Stratosphere, преди да промени името на Flink от своите създатели.

- Spark предоставя API на високо ниво в различни езици за програмиране като Java, Python, Scala и R. През 2014 г. Apache Flink беше приет за Apache Incubator Project от Apache Projects Group.

- Spark има основни функции като Spark Core, Spark SQL, MLib (машинна библиотека), GraphX (за обработка на графики) и Spark Streaming и Flink се използва за извършване на циклични и итеративни процеси чрез итерация на колекции.

- И Apache Spark, и Apache Flink са платформи за поточно предаване или обработка на данни с общо предназначение в средата с големи данни. Режимът на искрови клъстери може да се използва за поточно предаване и обработка на данни в различни клъстери за мащабни данни с цел бърза и паралелна обработка.

- Режимът Spark Cluster ще има приложения, работещи като отделни процеси в клъстера. Flink е силен високоефективен инструмент за обработка на партиди и процеси за планиране на задачи.

- Компонентите на Spark клъстера са Driver Manager, Driver Program и Worker Nodes. Flink има още една характеристика на добрия режим на съвместимост за поддържане на различни проекти на Apache, като буря на Apache и карта, намаляване на работните места в неговия механизъм за изпълнение, за да се подобри производителността на поточните данни.

- Spark има различни видове мениджъри на клъстери, като например мениджър на клъстери на прежди HADOOP, самостоятелен режим (вече обсъден по-горе), Apache Mesos (общ клъстер мениджър) и Kubernetes (експериментална, която е система с отворен код за внедряване на автоматизация). Flink има само двигател за обработка на данни в сравнение с Spark, който има различни основни компоненти.

- Функциите на компонентите на искровия клъстер имат задачи, кеш и изпълнители вътре в работния възел, където мениджърът на клъстери може да има множество работни възли. Flink архитектурата работи по такъв начин, че потоците не трябва да се отварят и затварят всеки път.

- Spark и Flink имат управление в паметта. Spark забива възела, когато му липсва памет, но има толерантност на грешки. Flink има различен подход към управлението на паметта. Flink пише на диск, когато в паметта изтече.

- Както Apache Spark, така и Apache Flink работят с проекта Apache Kafka, разработен от LinkedIn, който също е силно приложение за поток на данни с висока толерантност.

- Spark може да има възможност за споделяне на памет в различни приложения, пребиваващи в нея, докато Flink има явно управление на паметта, което предотвратява случайните шипове, присъстващи в Apache Spark.

- Spark има повече конфигурационни свойства, докато Flink има по-малко свойства на конфигурация.

- Flink може да приближи техники за обработка на партиди, а Spark има унифициран двигател, който може да се стартира независимо отгоре на Hadoop, като се свърже с много други мениджъри на клъстери и платформи или сървъри за съхранение.

- Използването на мрежата на Apache Spark е по-малко в началото на заданието, когато се задейства, което причинява известно забавяне при изпълнението на заданието. Apache Flink използва мрежата от самото начало, което показва, че Flink използва своя ресурс ефективно.

- По-малкото използване на ресурси в Apache Spark води до по-малко продуктивни, докато в Apache Flunk използването на ресурси е ефективно, което го прави по-продуктивен с по-добри резултати.

Apache Spark vs Apache Flink Таблица за сравнение

| ОСНОВА ЗА

СРАВНЕНИЕ | Apache Spark | Apache Flink |

| дефиниция | Бърз отворен код за големи обработки на данни | Клъстер с отворен код за поточно предаване и обработка на данни |

| Предпочитание | По-предпочитано и може да се използва заедно с много проекти на Apache | Flink се развива наскоро е по-малко предпочитан |

| Лесна употреба | По-лесно да извиквате API и да използвате | Има по-малко API в сравнение с Spark |

| платформа | Работи се с помощта на трети мениджъри на клъстери | Крос-платформа и поддържа повечето от интеграциите на приложения |

| всеобщност | Отворен код и се използва от много големи компании, базирани на данни | Отворен код и набира популярност напоследък |

| общност | Малко повече общност на базата на потребители | Необходимо е Общността да расте в сравнение с Spark |

| Сътрудници | Много големи сътрудници с отворен код | Имайте голяма база от участници |

| Време за изпълнение | Стартира процесите 100 пъти по-бързо от Hadoop | Малко по-бавно в сравнение с Spark |

Заключение - Apache Spark срещу Apache Flink

Apache Spark и Apache Flink и двете са приложения за обработка на потоци с обща цел, където предоставените от тях API и архитектурата и основните компоненти са различни. Spark има множество основни компоненти за изпълнение на различни изисквания за приложение, докато Flink има само капацитет за поточно предаване и обработка на данни.

В зависимост от бизнес изискванията, може да бъде избрана софтуерната рамка. Spark съществува от няколко години, докато Flink се развива постепенно в наши дни и има шансове Apache Flink да изпревари Apache Spark.

За да се интегрира с множество рамки, Spark е по-предпочитан в сравнение с Flink, за да поддържа множество приложения в разпределена среда.

Препоръчителен член

Това е ръководство за Apache Spark срещу Apache Flink, тяхното значение, сравнение между главата, ключови разлики, таблица на сравнението и заключение. Можете също да разгледате следните статии, за да научите повече -

- Apache Hadoop срещу Apache Spark | Топ 10 сравнения, които трябва да знаете!

- Най-добрите неща научете за Apache Spark (Ръководство)

- Apache Storm срещу Apache Spark - Научете 15 полезни разлики

- Най-добрите 15 неща, които трябва да знаете за MapReduce срещу Spark