Преглед на функциите на загуба при машинно обучение

Точно както учителите ни ръководят, независимо дали се представяме добре или не в нашите преподаватели, функциите на загуба вършат същата работа. Това е метод за оценка на това колко добре алгоритъмът ни моделира данните. Функциите на загуба са основният източник на оценка в съвременното машинно обучение. Когато промените алгоритъма си, за да подобрите модела си, стойността на функцията за загуба ще ви каже дали постигате напредък или не. Основната ни цел трябва да бъде да намалим функцията на загубите чрез оптимизация. В тази статия ще обсъдим как функционират функциите за загуба и различните видове функции за загуба.

Как функционират загубените функции?

Думата „Загуба“ посочва наказанието за неуспеха да се постигне очакваното производство. Ако отклонението в прогнозираната стойност от очакваната стойност от нашия модел е голямо, тогава функцията на загуба дава по-голямото число като изход и ако отклонението е малко и много по-близо до очакваната стойност, то извежда по-малко число.

Ето пример, когато се опитваме да предвидим продажната цена на къщата в градовете на метрото.

| Прогнозна

Продажна цена (In lakh) | действителен

Продажна цена (In lakh) | Отклонение (загуба) |

| Бангалор: 45 | 0 (Всички прогнози са верни) | |

| Пуна: 35 | ||

| Ченай: 40 | ||

| Бангалор: 40 | Бангалор: 45 | 5 lakh за Бангалор, 2 lakh за Chennai |

| Пуна: 35 | Пуна: 35 | |

| Ченай: 38 | Ченай: 40 | |

| Бангалор: 43 | 2 lakh за Бангалор, 5 lakh за, Pune2 lakh за Chennai, | |

| Пуна: 30 | ||

| Ченай: 45 |

Важно е да се отбележи, че размерът на отклонението няма значение, важното тук е дали стойността, предвидена от нашия модел, е правилна или грешна. Функциите за загуба се различават въз основа на вашето твърдение за проблема, към което се прилага машинното обучение. Функцията разходи е друг термин, който се използва взаимозаменяемо за функцията на загубата, но има малко по-различно значение. Функцията за загуба е за един пример за обучение, докато функцията за разходи е средната загуба за целия набор от данни за влакове.

Видове загубени функции при машинно обучение

По-долу са описани различните видове функции за загуба при машинно обучение, които са както следва:

1) Функции на загуба на регресия:

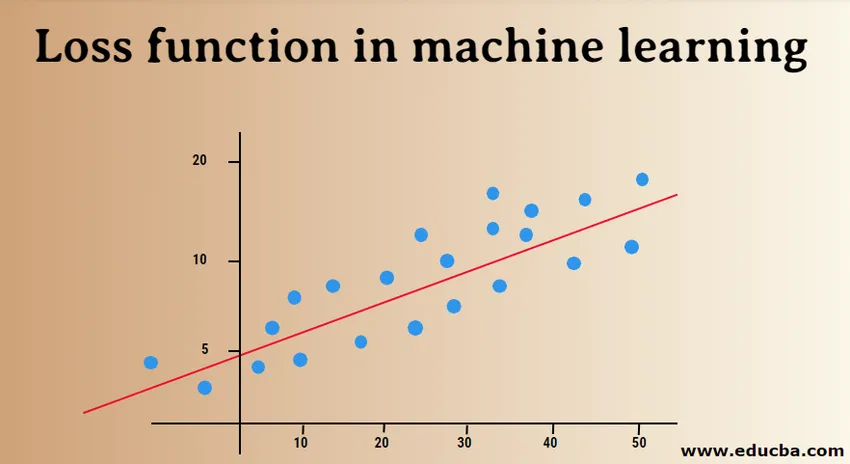

Линейната регресия е основна концепция на тази функция. Функциите на загуба на регресия установяват линейна връзка между зависима променлива (Y) и независима променлива (X), поради което се опитваме да поставим най-добрата линия в пространството на тези променливи.

Y = X0 + X1 + X2 + X3 + X4…. + Xn

X = независими променливи

Y = зависима променлива

- Средна загуба на грешка в квадрат:

MSE (грешка L2) измерва средната квадратна разлика между действителните и прогнозираните стойности от модела. Изходът е единично число, свързано с набор от стойности. Нашата цел е да намалим MSE, за да подобрим точността на модела.

Помислете за линейното уравнение, y = mx + c, можем да изведем MSE като:

MSE = 1 / N ∑i = 1 до n (y (i) - (mx (i) + b)) 2

Тук N е общият брой точки от данни, 1 / N ∑i = 1 до n е средна стойност, а y (i) е действителната стойност, а mx (i) + b неговата прогнозна стойност.

- Средна логаритмична загуба на грешка (MSLE):

MSLE измерва съотношението между действителната и прогнозната стойност. Той въвежда асиметрия в кривата на грешките. MSLE се грижи само за процентната разлика на действителните и прогнозираните стойности. Той може да бъде добър избор като функция за загуба, когато искаме да прогнозираме продажните цени на жилищата, продажните цени на хлебни изделия и данните са непрекъснати.

Тук загубата може да бъде изчислена като средна стойност на наблюдаваните данни на квадратните разлики между преобразуваните дневника реални и прогнозирани стойности, които могат да бъдат дадени като:

L = 1nnΣi = 1 (лог (у (и) 1) -log (у (и) 1)) 2

- Средна абсолютна грешка (MAE):

MAE изчислява сумата от абсолютни разлики между действителните и прогнозираните променливи. Това означава, че измерва средната величина на грешките в набор от прогнозирани стойности. Използването на средната квадратна грешка е по-лесно да се разреши, но използването на абсолютната грешка е по-стабилно за остарелите. Отрицатели са тези стойности, което се отклонява изключително от другите наблюдавани точки от данни.

MAE може да се изчисли като:

L = 1nnΣi = 1||y (I) - у (и) ||

2) Функции за загуба на двоична класификация:

Тези функции на загуба са направени за измерване на ефективността на класификационния модел. В този случай точките с данни са присвоени един от етикетите, т.е. или 0 или 1. Освен това те могат да бъдат класифицирани като:

- Двоична кръстосана ентропия

Това е функция за загуба по подразбиране при проблеми с бинарна класификация. Кръстосана ентропийна загуба изчислява ефективността на класификационен модел, който дава изход на стойност на вероятността между 0 и 1. Загубата на кръстосана ентропия се увеличава, когато прогнозираната стойност на вероятността се отклонява от реалния етикет.

- Загуба на панта

Загубата на панти може да се използва като алтернатива на крос-ентропията, която първоначално е разработена за използване с алгоритъм на машината за поддържащ вектор. Загубата на панти работи най-добре при проблем с класификацията, тъй като целевите стойности са в множеството (-1, 1). Той позволява да се присвои повече грешка, когато има разлика в знака между действителните и прогнозираните стойности. Това води до по-добри резултати от кръстосана ентропия.

- Загуба на панта в квадрат

Удължаване на загубата на панти, което просто изчислява квадрата на резултата за загуба на панта. Намалява функцията за грешка и я прави по-лесно цифровата работа. Той намира границата на класификация, която определя максималния марж между точките от данни на различни класове. Загубата на квадратна панта е идеална за ДА ИЛИ НЯМА проблеми с решението, когато отклонението от вероятността не е проблем.

3) Функции за загуба на класификация за много класове:

Класификацията в много класове са прогнозните модели, при които точките от данни са присвоени на повече от два класа. Всеки клас има уникална стойност от 0 до (Number_of_classes - 1). Силно се препоръчва при проблеми с класификацията на изображения или текст, при които една книга може да има множество теми.

- Многокласна кръстосана ентропия

В този случай целевите стойности са в множеството от 0 до n, т.е. (0, 1, 2, 3 … n). Той изчислява резултат, който взема средна разлика между действителните и прогнозираните стойности на вероятността и резултатът се свежда до минимум, за да се постигне най-добрата възможна точност. Многокласната кръстосана ентропия е функция по загуба по подразбиране при проблеми с класификацията на текст.

- Ръчна многокласна кръстосана ентропия

Един процес на горещо кодиране затруднява многокласната кръстосана ентропия за обработка на голям брой точки от данни. Рязката кръстосана ентропия решава този проблем чрез извършване на изчислението на грешката без използване на едно горещо кодиране.

- Отклонение от дивергенция на Kullback Leibler

KL загубата на дивергенция изчислява разликата между вероятностното разпределение и базовата разпределение и установява колко информация се губи по отношение на битовете. Изходът е неотрицателна стойност, която определя колко са близки две разпределения на вероятността. За да се опише дивергенцията на KL по отношение на вероятностния изглед, се използва коефициентът на вероятност.

В тази статия първоначално разбрахме как функционират функциите за загуба и след това продължихме да изследваме изчерпателен списък на функциите за загуба с използвани примери на случаи. Разбирането му на практика обаче е по-полезно, затова се опитайте да прочетете повече и да го приложите. Тя ще изясни старателно вашите съмнения.

Препоръчителни статии

Това е ръководство за загуба на функции в машинното обучение. Тук обсъждаме как функционират функциите за загуба и видовете загубени функции в машинното обучение. Може да разгледате и следните статии, за да научите повече -

- Методи за машинно обучение

- Въведение в машинното обучение

- Технологии за големи данни

- Софтуер за големи данни Анализ

- Научете катогориите на хиперпараметъра

- Жизнен цикъл на машинно обучение | Топ 8 етапа