Въведение в назад премахване

Тъй като човекът и машината чукат към цифровата еволюция, различните техники отчитат, за да се обучават не само, но и умело обучени, за да излязат с по-добро разпознаване на обекти от реалния свят. Подобна техника, въведена по-рано, наречена „Обратно премахване“, която има за цел да благоприятства незаменимите функции, като същевременно премахва задължителните функции, за да се отдаде на по-добра оптимизация в машината. Цялата владеене на разпознаване на обекти от Машина е пропорционална на това, какви характеристики разглежда.

Функции, които нямат референция за прогнозирания изход, трябва да се изхвърлят от машината и това се завършва чрез елиминиране назад. Добрата прецизност и сложността на времето за разпознаване на всеки истински обект на дума от машина зависи от неговото усвояване. Така елиминирането назад играе своята твърда роля за избор на функции. Той отчита скоростта на зависимост на характеристиките към зависимата променлива, намира значението на нейната принадлежност в модела. За да акредитира това, той проверява отчетения процент със стандартно ниво на значимост (да кажем 0, 06) и взема решение за избор на функция.

Защо пристъпваме към обратно премахване ?

Несъществени и излишни черти задвижват сложността на машинната логика. Той изяжда излишно време и ресурси на модела. Така че гореспоменатата техника играе компетентна роля, за да формира модела до просто. Алгоритъмът култивира най-добрата версия на модела чрез оптимизиране на неговата производителност и съкращаване на неговите целеви ресурси.

Това ограничава най-малко забележителните характеристики от модела, което причинява шум при определяне на регресионната линия. Нерелевантните черти на обекта могат да доведат до погрешна класификация и прогнозиране. Нерелевантните характеристики на предприятието могат да представляват дисбаланс в модела по отношение на други значими характеристики на други обекти. Обратното отстраняване насърчава прилягането на модела в най-добрия случай. Следователно елиминирането назад се препоръчва да се използва в модел.

Как да приложите елиминация назад?

Обратното елиминиране започва с всички променливи на характеристиките, като се изпробва с зависимата променлива при избран критерий на модела. Той започва да изкоренява онези променливи, които влошават прилягащата регресия. Повтаряне на това изтриване, докато моделът постигне добра форма. По-долу са стъпките за практикуване на елиминирането назад:

Стъпка 1: Изберете подходящото ниво на значимост, за да се намирате в модела на машината. (Вземете S = 0, 06)

Стъпка 2: Попълнете всички налични независими променливи към модела по отношение на зависимата променлива и компютрирайте наклона и прихващайте, за да начертаете линия на регресия или фитинг.

Стъпка 3: Преминете с всички независими променливи, които притежават най-високата стойност (Вземете I), една по една и продължете със следния тост: -

а) Ако I> S, изпълнете 4-та стъпка.

б) Оставете да прекъснете и моделът е перфектен.

Стъпка 4: Премахнете избраната променлива и увеличете хода.

Стъпка 5: Повторно коване на модела отново и изчисляване на наклона и прехващането на монтажната линия отново с остатъчни променливи.

Гореспоменатите стъпки се обобщават в отхвърлянето на онези характеристики, чийто процент на значимост е над избраната стойност на значимостта (0, 06), за да се избегне свръхкласификацията и преизползването на ресурси, които се наблюдават като висока сложност.

Заслуги и недостатъци на назад премахване

Ето някои достойнства и недостатъци на елиминирането назад, дадени по-долу подробно:

1. Заслуги

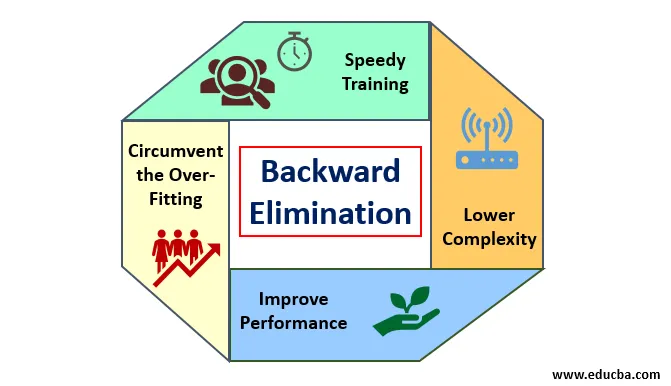

Предимствата на елиминирането назад са следните:

- Бързо обучение: Машината се обучава с набор от налични функции на модел, който се прави за много кратко време, ако от модела бъдат премахнати несъществени характеристики. Бързото обучение на набор от данни влиза в картината само когато моделът се занимава със значителни характеристики и изключва всички променливи на шума. Извлича проста сложност за обучение. Но моделът не трябва да се подлага на недостатъчно монтиране, което се случва поради липса на характеристики или неадекватни проби. Примерната характеристика трябва да бъде изобилна в модел за най-добра класификация. Времето, необходимо за обучението на модела, трябва да бъде по-малко, като същевременно се запазва точността на класификацията и не остава променлива с ниско предвиждане

- По-ниска сложност: Сложността на модела се оказва висока, ако моделът обмисля степента на функции, включително шум и несвързани функции. Моделът отнема много място и време, за да обработи такъв обхват от функции. Това може да увеличи степента на точност на разпознаване на образа, но скоростта може да съдържа и шум. За да се отървем от такава голяма сложност на модела, алгоритъмът за елиминиране назад играе необходима роля, като премахва нежеланите характеристики от модела. Опростява логиката на обработка на модела. Само няколко основни характеристики са достатъчни, за да начертаят добра форма, съдържаща разумна точност.

- Подобряване на производителността: Производителността на модела зависи от много аспекти. Моделът се подлага на оптимизация чрез използване на елиминиране назад. Оптимизацията на модела е оптимизация на базата данни, използвана за обучение на модела. Производителността на модела е пряко пропорционална на скоростта му на оптимизация, която разчита на честотата на значимите данни. Процесът на елиминиране назад не е предназначен да започне промяна от нискочестотен предсказател. Но той започва промяна само от високочестотни данни, защото най-вече сложността на модела зависи от тази част.

- Обход на свръх-монтаж: ситуацията на свръхприлягането се случва, когато моделът има твърде много набори от данни и се провежда класификация или прогнозиране, при които някои прогнозатори са получили шум от други класове. В този монтаж, моделът трябва да даде неочаквано висока точност. При прекалено подходящ модел моделът може да не успее да класифицира променливата поради объркване, създадено в логиката поради твърде много условия. Техниката за елиминиране назад намалява външната функция за заобикаляне на ситуацията на прекалено прилягане.

2. Демерите

Недостатъците на елиминиране назад са както следва:

- При метода на елиминиране назад не може да се установи кой предсказател е отговорен за отхвърлянето на друг прогнозатор поради достигането му до незначителност. Например, ако предсказателят X има някакво значение, което беше достатъчно добро, за да пребивава в модел след добавяне на Y предсказател. Значението на X обаче остарява, когато в модела влезе друг предсказател Z. Така че алгоритъмът за елиминиране назад не е очевиден за каквато и да е зависимост между два предсказателя, които се случват в „техниката за избор напред“.

- След изхвърлянето на която и да е функция от модел чрез алгоритъм за елиминиране назад, тази функция не може да бъде избрана отново. Накратко, елиминирането назад няма гъвкав подход за добавяне или премахване на функции / предсказатели.

- Нормите за избор на стойността на значимостта (0, 06) в модела са негъвкави. Обратното елиминиране не разполага с гъвкава процедура, която не само да избере, но и да промени незначителната стойност, както се изисква, за да се постигне най-доброто напасване в подходящ набор от данни.

заключение

Техниката за елиминиране назад е реализирана да подобри работата на модела и да оптимизира неговата сложност. Той се използва ярко в множество регресии, където моделът се занимава с обширния набор от данни. Това е лесен и прост подход в сравнение с избора напред и кръстосаното валидиране, при който се среща претоварване на оптимизацията. Техниката за елиминиране назад е инициирала елиминирането на функции с по-голяма значимост. Нейната основна цел е да направи модела по-малко сложен и да забрани прекалено подходящата ситуация.

Препоръчителни статии

Това е ръководство за назад премахване. Тук обсъждаме как да приложим елиминиране назад, заедно с достойнствата и недостатъците. Можете също да разгледате следните статии, за да научите повече-

- Хиперпараметрово машинно обучение

- Клъстеризиране в машинно обучение

- Java виртуална машина

- Неподдържано машинно обучение